จากแรกเริ่มที่ฟังก์ชั่นถ่ายภาพบนสมาร์ทโฟน เป็นเพียงส่วนเสริมที่ถูกใส่เข้ามาจากผลพวงของกระแสโลกาภิวัฒน์ที่ไม่ได้มีคุณภาพสูสีกล้องถ่ายรูปสักเท่าไหร่ แต่หลังจากที่วิวัฒนาการของเทคโนโลยีได้พัฒนาขึ้นอย่างก้าวกระโดด ฟังก์ชั่นดังกล่าวก็มีประสิทธิภาพมากพอจนกลายเป็นหนึ่งในจุดขายที่แบรนด์ต่างๆ นำมาใช้เป็นไม้เด็ดในผลิตภัณฑ์ของตน ทำให้ในปัจจุบัน ทุกแบรนด์ต่างก็มีมาตรฐานเริ่มต้นของกล้องที่ใกล้เคียงกัน

วันนี้ทางแบไต๋ของเราเลยพอจะอธิบายถึง 3 เทคนิคที่ว่าทำไม “สมาร์ทโฟนทั้งหลายถึงถ่ายภาพหน้าชัดหลังเบลอได้” ถ้าพร้อมตามไปลุยกันได้เลย

1. จำลองการรับภาพของมนุษย์ที่ออกมาในรูปแบบเลนส์คู่

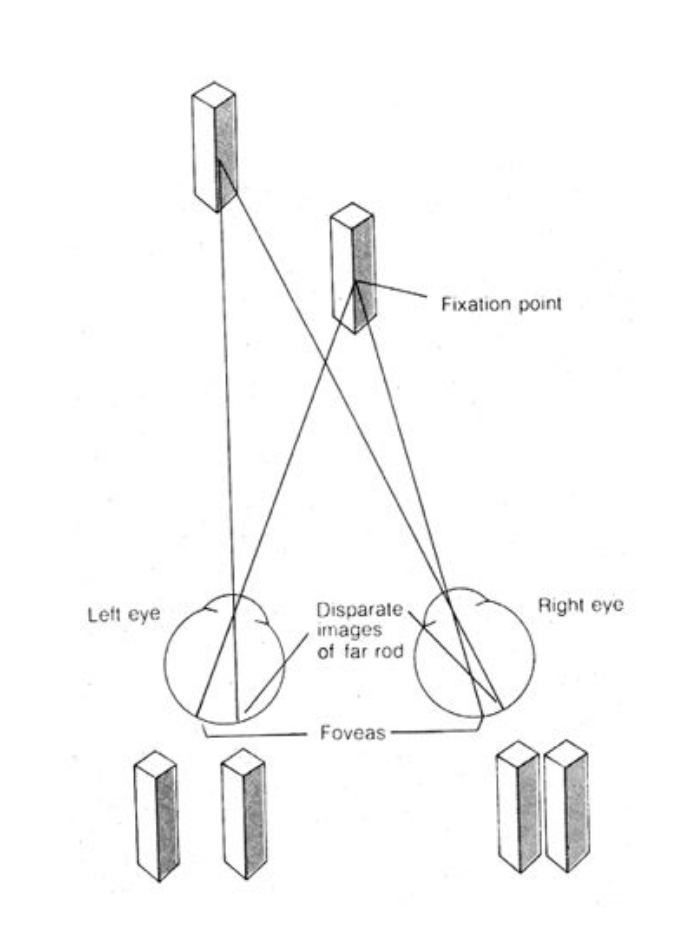

กล้องทุกประเภทบนโลกเป็นการจำลองวิธีการรับภาพเหมือนสายตาของมนุษย์ที่รับภาพได้แบบ 3 มิติ โดยหากอธิบายแบบคร่าวๆ เมื่อเวลาที่เราใช้ตามองวัตถุที่มีระยะห่างกัน วัตถุที่อยู่ใกล้ดวงตามากที่สุดจะเห็นได้ชัดและคม ในขณะวัตถุใดที่ห่างจากสายตาเรามากที่สุดก็จะเห็นได้ว่าวัตถุนั้นมัวขุ่น ซึ่งหากเอามาเปรียบเทียบภาพที่เราได้จากกล้องมันก็คือภาพที่หน้าชัดหลังเบลอนั่นเอง

แต่กระนั้น ขนาดของเซนเซอร์บนกล้องทุกประเภท ก็ไม่สามารถเทียบเคียงการมองเห็นของมนุษย์ได้โดยสมบูรณ์ และโดยเฉพาะอย่างยิ่งกับเซนเซอร์กล้องของสมาร์ทโฟนที่มีขนาดค่อนข้างจะเล็กแต่กลับมีมุมรับภาพที่กว้าง ทำให้ผลลัพธ์ของภาพถ่ายที่ออกมาจึงกลายเป็นภาพที่วัตถุทั้งหมดในรูปถูกโฟกัสหรือมีระยะห่างของความชัดตื้นที่ไม่มากนัก

หลายแบรนด์ (Apple, Huawei, Vivo, Oppo ฯลฯ) จึงทำให้สมาร์ทโฟนสามารถถ่ายภาพได้สวยงามไม่น้อยหน้าไปกว่ากล้องโปร ด้วยการดัดแปลงการจำลองการรับภาพของมนุษย์ที่ออกมาในรูปแบบของเลนส์คู่ (แต่ปัจจุบันเห็นมีมากสุดตั้ง 4 เลนส์แล้วแน่ะ!) โดยสมาร์ทโฟนจะยังมีเซนเซอร์ขนาดเท่าเดิม แต่จะมีกล้องสองตัวที่ทำงานคนละส่วนและเลนส์ที่ใช้ระยะรับภาพแตกต่างกัน

โดยกล้องตัวแรกจะใช้เลนส์ Wide ที่มีทางยาวโฟกัสต่ำที่จะจับความคมชัดของตัวแบบที่อยู่ข้างหน้าได้ดี ในขณะที่กล้องอีกตัวจะใช้เลนส์ Telephoto มีทางยาวโฟกัสไกลที่จะใช้ในการเก็บรายละเอียดของฉากหลังทั้งหลาย อาทิ แสงเงา, การละลายฉากหลัง ฯลฯ ซึ่งเมื่อได้ภาพจากทั้งสองกล้องเรียบร้อยก็จะถูกนำมาประมวลผลและรวมเป็นภาพเดียวกันผ่านซอฟต์แวร์

แต่ข้อเสียของเลนส์คู่เลย คือฉากหลังของภาพถ่ายประเภทบุคคลจะถูกละลายและเบลอในปริมาณสูงเนื่องจากเป็นการละลายฉากหลังที่เกิดขึ้นจากกล้องที่ใช้เลนส์ Telephoto นั่นเอง และหากเลนส์คู่ตัวหนึ่งเป็น telephoto มันก็ต้องใช้เลนส์ตัวนั้นในการถ่ายเพราะมันจะเบลอหลังได้เฉพาะส่วนที่ทับซ้อนกันของ 2 เลนส์

2. เทคโนโลยี TrueDepth (อินฟาเรดเซนเซอร์)

เทคโนโลยี TrueDepth อันเป็นการใช้แสงอินฟาเรดกว่า 30,000 จุด ที่จะส่องมายังบริเวณต่างๆ บนใบหน้าของเราเพื่ออ้างอิงความลึกตึ้นหรือสัดส่วนต่างๆ และสแกนออกมาเป็นสามมิติเพื่อที่ใบหน้าของเราเพียงผู้เดียวที่จะใช้ในการปลดล็อคเครื่อง

แต่จริงๆ แล้วเทคโนโลยีดังกล่าว Apple ยังได้ทำมาเสริมใส่การถ่ายภาพประเภทบุคคลอีกด้วยนะ ซึ่งก็เป็นการต่อยอดนำวิธีการสแกนใบหน้าจากเทคโนโลยีนี้ด้วยการจดจำความลึกตื้นหรือรูปทรงใบหน้าของเราและแยกใบหน้าของตัวแบบออกจากฉากหลังได้

แต่ข้อเสียจากการใช้เทคโนโลยี TrueDepth มาถ่ายภาพประเภทบุคคล คือหากเราถ่ายในที่ๆ มีแสงอาทิตย์แรงจัด คุณภาพในการละลายฉากหลังจะผิดเพี้ยนเพราะแสงอินฟาเรดจากกล้องหน้าจะถูกแสงจากพระอาทิตย์รบกวนเพราะมีรูปแบบของแสงที่ใกล้เคียงกัน

3. ใช้ปัญญาประดิษฐ์ร่วมกับ Dual Pixel Autofocus

Google Pixel 2 ไม่ได้ใช้เลนส์คู่ตามกระแสนิยม แต่กลับเลือกที่จะใช้ Dual Pixel Autofocus (ที่มีในสมาร์ทโฟนส่วนใหญ่อยู่แล้ว) เทคโนโลยีที่ทำให้การโฟกัสภาพรวดเร็วและแม่นยำขึ้นด้วยการแยกแสงออกมาเป็น 2 เส้นเข้าไปยังชิปประมวลผลและใช้ผลต่างที่ได้จากทั้งสองฝั่งในการคำนวณหาจุดที่เหมาะสมแก่การโฟกัสจุดถัดไป ผสมเข้ากับปัญญาประดิษฐ์ที่สามารถแยกตัวแบบที่เป็นบุคคลออกจากฉากหลังได้หลากหลายวิธีการ อาทิ การมาร์คกลุ่มสีของผิวมนุษย์, ตรวจจับเส้นโครงร่างสรีระของร่างกายมนุษย์ ฯลฯ

ซึ่งสมาร์ทโฟนรุ่นล่าสุดของทาง Apple อย่าง iPhone XR ก็ได้ใช้เทคโนโลยีในการถ่ายภาพบุคคลที่คล้ายคลึงกันกับทาง Google Pixel 2 แต่จะเน้นหนักและต่อยอดไปทางปัญญาประดิษฐ์ที่มีชื่อว่า Portrait Effects Matte (PEM) ที่จะสามารถหาบุคคลในเฟรมได้ในทันท่วงทีจากการฝึกสอนป้อนข้อมูลของภาพถ่ายสี 2 มิติทั่วไปและจากการจำลองความชัดตื้นชัดลึกแบบ 3 มิติ ซึ่งซอฟต์แวร์ก็จะประมวลผลพื้นที่จากในภาพว่าบริเวณใดคือเส้นโครงร่างของบุคคลรวมถึงวัตถุต่างๆ ที่อยู่บนตัว (เส้นผม, แว่นตา ฯลฯ) ก็จะไม่ถูกเบลอทิ้งอีกต่อไป

ที่มา: petapixel, blog.halide, AI.googleblog