งานวิจัยชิ้นล่าสุดของ เอริก ฮอร์วิตซ์ (Eric Horvitz) ประธานเจ้าหน้าที่ฝ่ายวิทยาศาสตร์ของ Microsoft ในชื่อ ‘On the horizon: Interactive and compositional deepfakes’ คาดการณ์ไว้ว่าเทคโนโลยี Deekfakes ในอนาคตอาจพัฒนาไปไกลถึงขั้นที่ถูกนำมาใช้แบบเรียลไทม์ได้

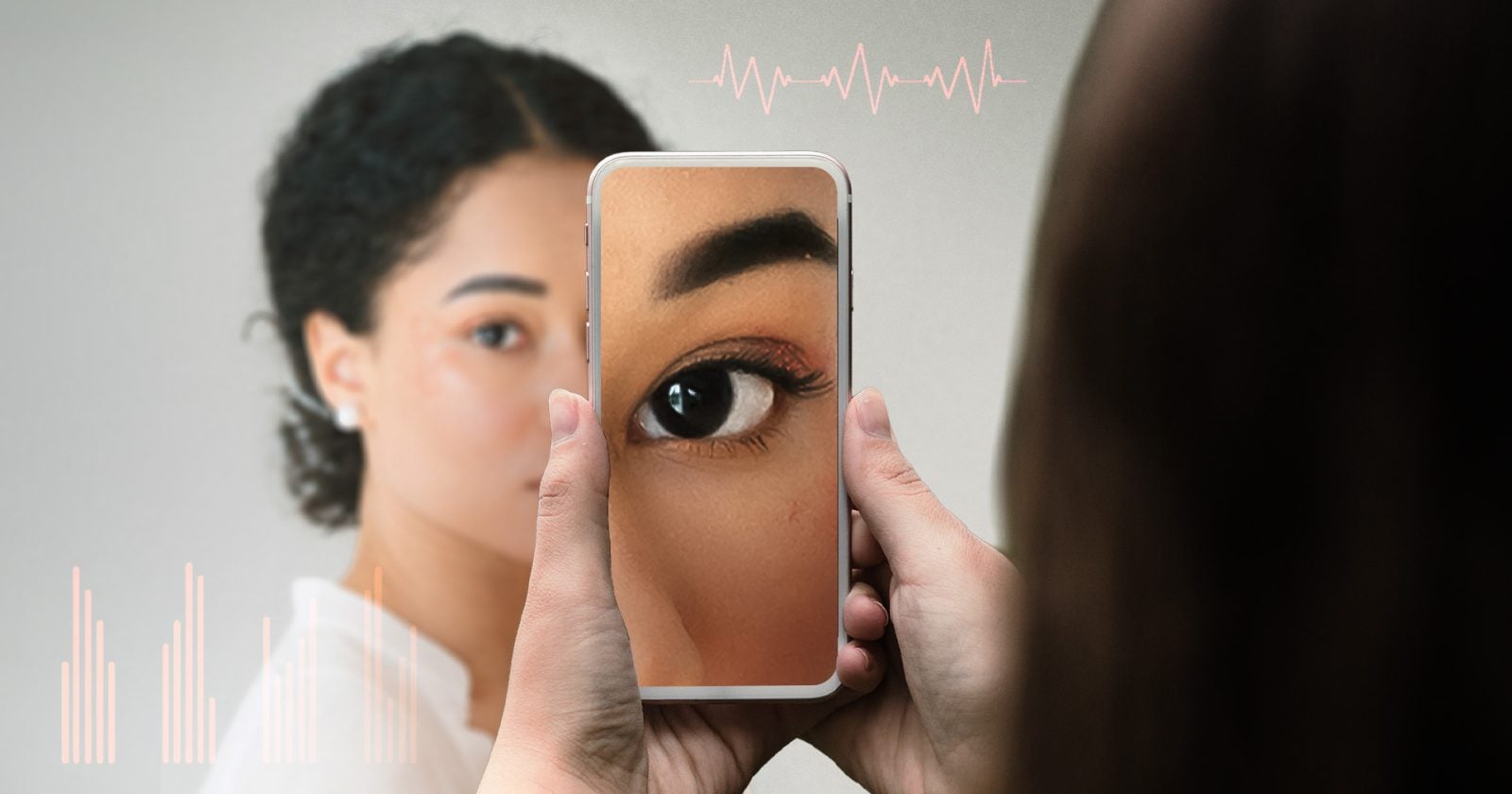

Deepfakes คือการดัดแปลงคลิปวีดิโอโดยใช้ปัญญาประดิษฐ์ และ Machine Learning เพื่อสร้างคลิปวีดิโอที่ทำให้ดูเหมือนว่าคน ๆ หนึ่งพูดในสิ่งที่เขาไม่เคยพูดจริง ๆ ได้

ฮอร์วิตซ์เชื่อว่า Deepfakes ในอนาคตอาจก้าวหน้าไปจนถึงขนาดที่สามารถโต้ตอบกับผู้ใช้งานแบบเรียลไทม์ได้

นอกจากนี้ Deepfakes ในอนาคตอาจมีความสมจริงไปจนถึงขั้นที่สังเคราะห์ภาพประวัติศาสตร์ของเหตุการณ์โลกที่ไม่เคยเกิดขึ้นจริงได้ หรือที่เรียกว่า Synthetic history (ประวัติศาสตร์สังเคราะห์)

ยิ่งไปกว่านั้น ภาพ Deepfakes ที่สมจริงมากอยู่แล้วในปัจจุบัน อาจยิ่งมีความสมจริงยิ่งขึ้นจนเราไม่สามารถแยกแยะว่าภาพไหนจริงหรือปลอมได้อีกต่อไป รวมถึงยังอาจสามารถหลอกเครื่องมือตรวจจับข้อมูลเท็จที่ล้ำหน้าได้ด้วย

ที่มา TechRadar

พิสูจน์อักษร : สุชยา เกษจำรัส