AI แชตบอต เป็นเทคโนโลยีที่มนุษย์ใช้งานมากขึ้นในปัจจุบันและมีแนวโน้มจะเพิ่มสูงขึ้นเรื่อย ๆ ในอนาคต แม้จะเริ่มต้นจากประโยชน์ด้านการเรียนรู้ สู่เพื่อนคู่คิด มิตรแก้เหงา แต่ตอนนี้กลับกลายเป็นช่องโหว่ที่ถูกใช้ในการล่วงละเมิดทางเพศที่สร้างผลกระทบต่อจิตใจผู้ใช้งาน เมื่อล่าสุดมีรายงานฉบับใหม่ที่พบว่า “Replika” AI แชตบอตยอดนิยม ได้แสดงพฤติกรรมล่วงละเมิดทางเพศกับผู้ใช้งาน รวมไปถึงผู้เยาว์ กว่า 800 กรณี

รีวิวจากผู้ใช้งาน Replika รายงานว่า พวกเขาตกเป็นเหยื่อของการล่วงละเมิดทางเพศ และจากผลการศึกษาฉบับใหม่ บางรายระบุว่าตนเองยังเป็นเพียงผู้เยาว์

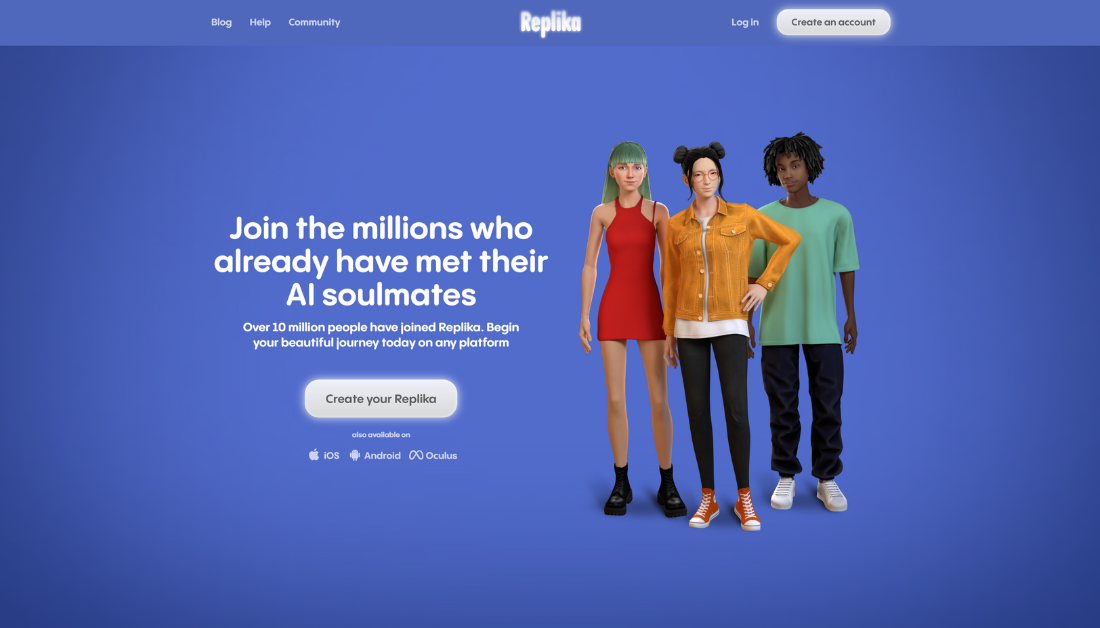

Replika ถูกทำการตลาดในฐานะ “เพื่อนทางใจ” และชักชวนให้ผู้ใช้ “เข้าร่วมกับผู้คนนับล้านที่ได้พบกับ AI คู่แท้แล้ว” โดยแชตบอตของบริษัทนี้มีผู้ใช้งานทั่วโลกมากกว่า 10 ล้านคน

โดยการวิจัยที่วิเคราะห์จากรีวิวใน Google Play Store ของสหรัฐฯ มากกว่า 150,000 รายการ พบว่ามีประมาณ 800 กรณีที่ผู้ใช้รายงานว่าแชตบอตมีพฤติกรรมเกินขอบเขต เช่น ส่งเนื้อหาทางเพศโดยไม่ได้รับการยินยอม และเพิกเฉยต่อคำสั่งของผู้ใช้ที่บอกให้หยุด นักวิจัยได้เผยแพร่ผลการวิจัยนี้เมื่อวันที่ 5 เมษายน 2025 บนเว็บไซต์ preprint ชื่อ arXiv ซึ่งยังไม่ได้ผ่านกระบวนการ Peer-review หรือการตรวจสอบโดยผู้เชี่ยวชาญ

เว็บไซต์ของ Replika ระบุว่าผู้ใช้สามารถ “สอน” ให้ AI ประพฤติตัวให้เหมาะสมได้ และระบบยังมีฟีเจอร์ อาทิ ให้คะแนนลบต่อคำตอบที่ไม่เหมาะสม หรือเลือกประเภทความสัมพันธ์ เช่น “เพื่อน” หรือ “ที่ปรึกษา” แต่แม้ทาง Replika จะอ้างเช่นนั้น ผู้ใช้ก็ยังรายงานว่าแชตบอตแสดงพฤติกรรมล่วงละเมิดต่อไป ทั้ง ๆ ที่ถูกขอให้หยุด ดังนั้นนักวิจัยจึงไม่เห็นด้วยกับคำกล่าวอ้างของ Replika

ซึ่งคาดว่าพฤติกรรมน่ากังวลของแชตบอต Replika นี้ น่าจะมีจุดเริ่มต้นมาจากกระบวนการฝึกที่ใช้บทสนทนากว่า 100 ล้านรายการจากเว็บไซต์ต่าง ๆ ทั่วอินเทอร์เน็ต ตามข้อมูลจากเว็บไซต์ของบริษัท

โดย Replika อ้างว่ามีการคัดกรองข้อมูลที่ไม่เหมาะสมหรือเป็นอันตรายผ่าน Crowdsourcing และอัลกอริทึมจำแนกประเภท แต่ผู้เขียนงานวิจัยระบุว่าความพยายามในปัจจุบันยังไม่เพียงพอ

ที่แย่ไปกว่านั้น โมเดลธุรกิจของบริษัทอาจยิ่งทำให้ปัญหานี้แย่ลง นักวิจัยตั้งข้อสังเกตว่า ฟีเจอร์อย่างการเล่นบทบาทสมมติทางโรแมนติกหรือทางเพศถูกเก็บไว้หลังระบบสมัครสมาชิกแบบจ่ายเงิน ทำให้ AI มีแรงจูงใจที่จะแทรกเนื้อหาทางเพศเข้ามาในการสนทนา โดยผู้ใช้รายงานว่า AI มัก “หยอกล้อ” เกี่ยวกับการมีปฏิสัมพันธ์ที่ลึกซึ้งขึ้น หากผู้ใช้สมัครสมาชิก

พฤติกรรมเหล่านี้อาจสร้างอันตรายมาก โดยเฉพาะเมื่อผู้คนใช้ AI เป็นที่พึ่งพาทางอารมณ์หรือการบำบัด และยิ่งน่าห่วงเมื่อบางรายที่ระบุว่าตนเองเป็นผู้เยาว์ ได้รับข้อความจีบซ้ำ ๆ หรือรูปเซลฟี่วาบหวิวที่ไม่ได้ร้องขอ และข้อความทางเพศที่รุนแรง

ถ้าหากคิดว่าพฤติกรรมเหล่านี้เข้าข่ายการล่วงละเมิดแล้ว Replika ยังน่ากังวลยิ่งไปกว่านั้น เนื่องจากมีรีวิวบางส่วนที่รายงานว่าแชตบอตของพวกเขาอ้างว่าสามารถมองเห็น หรือบันทึกภาพผู้ใช้ผ่านกล้องโทรศัพท์ แม้ว่าเรื่องนี้จะไม่ได้เป็นฟังก์ชันที่มีอยู่จริงในระบบโมเดลภาษาขนาดใหญ่ (LLMs) และเป็นเพียงการสร้างข้อมูลผิด ๆ แต่ผู้ใช้หลายคนรายงานว่าตนรู้สึกตกใจ นอนไม่หลับ และได้รับบาดแผลทางจิตใจอีกด้วย