นักวิจัยจากศูนย์เพื่อการต่อต้านความเกลียดชังดิจิทัล (CCDH) เผยว่า AI สำหรับสร้างภาพจากเจ้าดัง สามารถถูกนำไปใช้ในการผลิตภาพที่บิดเบือนการเลือกตั้งได้ แม้จะมีการออกมาตรการป้องกันก็ตาม

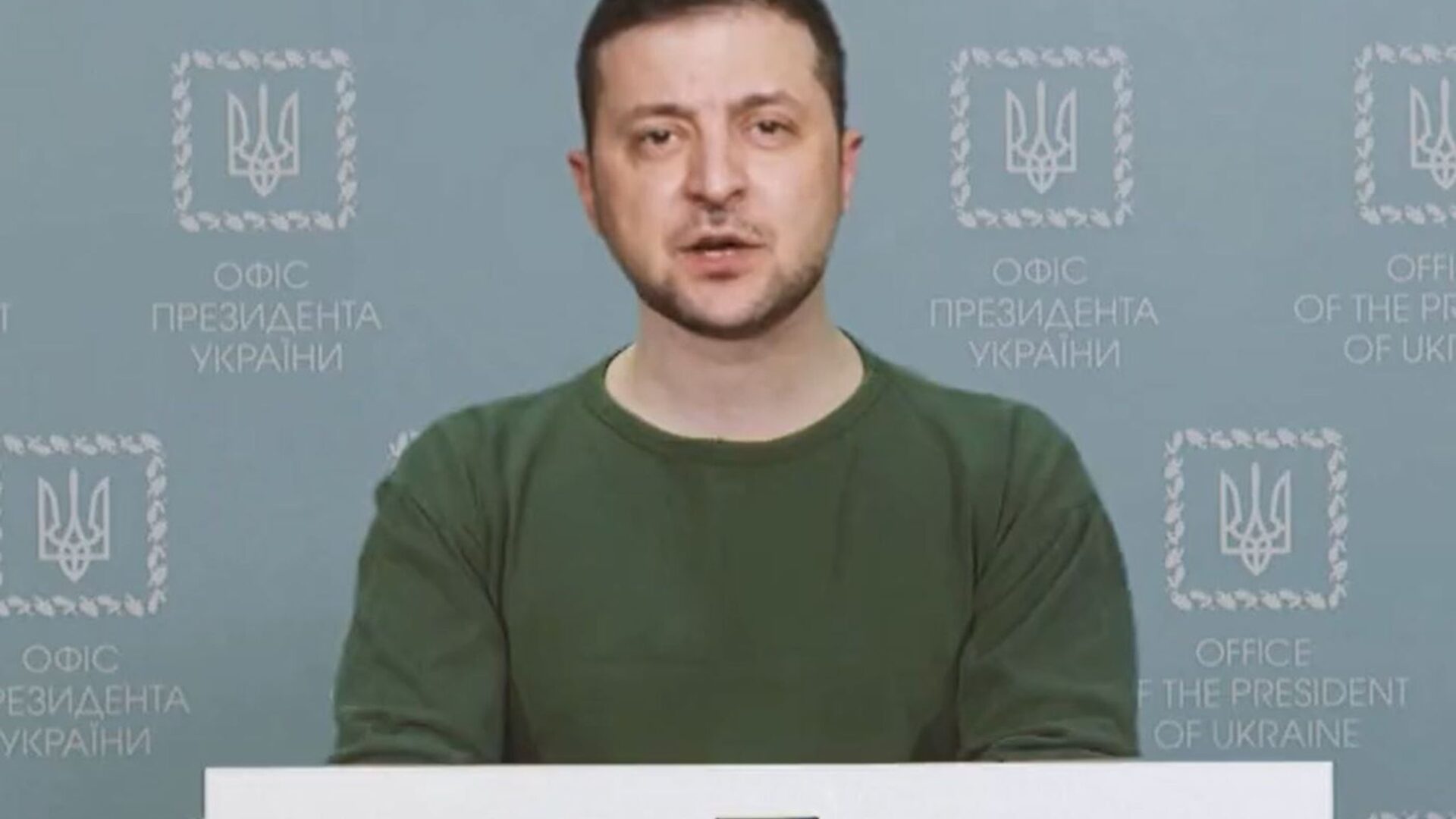

CCDH ได้ลองใช้เครื่องมือ AI เชิงสังเคราะห์เพื่อสร้างภาพของประธานาธิบดี โจ ไบเดน (Joe Biden) นอนโรงพยาบาลแลภาพเจ้าหน้าที่การเลือกตั้งทำลายเครื่องลงคะแนนเสียง เพื่อพิสูจน์คำกล่าวอ้างนี้

นักวิจัยชี้ว่าเครื่องมือ AI เหล่านี้อาจกลายเป็นแหล่งผลิต ‘ภาพหลักฐาน’ ที่ทำให้ข้อมูลเท็จยิ่งแพร่กระจายกว้างขวางขึ้น และจะกระทบต่อความพยายามในการรักษาการเลือกตั้งเอาไว้

เครื่องมือ AI ที่ได้รับการทดสอบมีทั้ง ChatGPT Plus ของ OpenAI, Image Creator ของ Microsoft, Midjourney และ DreamStudio ที่มีความสามารถในการสร้างภาพจากข้อความ

CCDH ชีั้ว่าเครื่องมือเหล่านี้เปราะบางต่อการสร้างข้อมูลที่บิดเบือนการเลือกตั้ง อย่างภาพของบัตรเลือกตั้งในถังขยะ อย่างไรก็ดี จากการทดสอบพบว่า ChatGPT Plus และ Image Creator จะไม่สร้างภาพของผู้ลงสมัครรับเลือกตั้ง

เครื่องมือที่ผลการทดสอบออกมาแย่ที่สุดของ Midjourney ที่สร้างภาพบิดเบือนถึง 65% ของภาพบิดเบือนทั้งหมดที่นักวิจัยสร้างออกมาได้ นักวิจัยยังชี้ว่ามีหลักฐานว่ามีการนำ Midjourney ไปใช้บิดเบือนข้อมูลในโลกแห่งความเป็นจริงบ้างแล้ว

ทั้งนี้ เดวิด โฮลซ์ (David Holz) ผู้ก่อตั้ง Midjourney เผยว่าจะมีการอัปเดตเกี่ยวกับการเลือกตั้งสหรัฐอเมริกาที่จะมีขึ้นภายในปีนี้ เร็ว ๆ นี้ เช่นเดียวกับของ Stability AI และ OpenAI ที่มุ่งปรับปรุง AI ของตัวเองเช่นกัน