เดี๋ยวนี้ใคร ๆ ก็ใช้ AI เป็นเหมือนผู้ช่วยส่วนตัว ตั้งแต่วางแผนเที่ยวไปจนถึงถามเรื่องสุขภาพ แต่เคยคิดไหมว่า ถ้าเราเชื่อคำแนะนำของมันแบบไม่ลืมหูลืมตา การพรอมต์แบบขาดบริบท หรือแม้แต่การขาดความรู้ในการตีความข้อมูล โดยเฉพาะเรื่องที่เกี่ยวกับสุขภาพและชีวิต อะไรจะเกิดขึ้น ?

BT beartai จะมาเล่าเคสจริงเกี่ยวกับคนที่หาข้อมูลจาก AI เพื่อดูแลสุขภาพจนเกิดปัญหา โดยเคสนี้ถูกตีพิมพ์เป็นกรณีศึกษาทางการแพทย์บน APC Journal

เริ่มต้นด้วยการแชตกับ ChatGPT และจบลงที่ห้องฉุกเฉิน

เรื่องนี้เริ่มจากชายวัย 60 ปีคนหนึ่ง ซึ่งไม่เคยมีประวัติป่วยทางจิตหรือโรคประจำตัวมาก่อน จู่ ๆ เขาก็มาที่ห้องฉุกเฉินด้วยอาการสับสนและมึนงงอย่างหนัก พร้อมบอกกับเจ้าหน้าที่ว่า เพื่อนบ้านจะลอบวางยาพิษเขา

ในตอนแรก ทีมหมอยังจับต้นชนปลายไม่ถูก เพราะจากการสอบถาม เขาบอกกับหมอว่าเขาไม่ได้ใช้ยาหรืออยู่ระหว่างการรักษาโรคใด ๆ เลย การทำงานของระบบประสาทในเบื้องต้นเป็นปกติ ทั้งยังไม่มีร่องรองของแอลกอฮอลล์และยาเสพติดในร่างกาย

แต่พอผลเลือดค่าอื่น ๆ ออกมาก็ทำเอาหมองง เพราะเจอค่าความผิดปกติหลายอย่าง เช่น คลอไรด์สูงในระดับที่ผิดปกติ (Hyperchloremia) ค่าบ่งชี้ความสมดุลกรด-ด่างติดลบ (Anion Gap) และภาวะกรด-ด่างอื่น ๆ ที่ผิดปกติ ซึ่งเป็นตัวเลขแปลก ๆ ที่แม้แต่หมอก็ไม่ค่อยได้เห็นกันบ่อย ทีมแพทย์จึงประสานไปยังศูนย์พิษวิทยาเพื่อขอข้อมูล

โดยในช่วง 24 ชั่วโมงแรก อาการของผู้ป่วยแย่ลงเรื่อย ๆ เริ่มเห็นภาพหลอน หวาดระแวงมากขึ้น ได้ยินเสียงแว่วในหู และพยายามจะหนีออกจากโรงพยาบาล จนสุดท้ายหมอต้องสั่งจ่ายยาจิตเวชและให้ดูแลอย่างใกล้ชิดเพื่อความปลอดภัย

เมื่ออาการดีขึ้น เขาได้ให้ข้อมูลว่า ในช่วงที่ผ่านมาเขาพบกับอาการที่ไม่เคยเป็นมาก่อน อย่างเป็นสิว ไฝแดง (Cherry angiomas) อ่อนเพลีย นอนไม่หลับ เดินเซ และกระหายน้ำมากกว่าปกติ

เขายังได้เล่าต่อไปว่า เขาได้อ่านเกี่ยวกับผลเสียต่อสุขภาพของโซเดียมคลอไรด์หรือที่เรารู้จักกันในชื่อเกลือแกง ร่วมกับการที่เขาเคยเรียนเรื่องโภชนาการมาก่อน เขาเลยปิ๊งไอเดียบางอย่างขึ้น และทดลองทำสิ่งนั้นกับตัวเอง เขาเริ่มต้นโปรเจกต์ดูแลสุขภาพสุดพิศดารด้วยการถาม ChatGPT ว่ามีอะไรที่สามารถใช้ทดแทนการใช้เกลือแกงได้ไหม ?

ซึ่ง ChatGPT ก็ตอบว่ามีสารที่ทดแทนโซเดียมคลอไรด์ได้ และหนึ่งในนั้น คือ โซเดียมโบรไมด์ (Sodium Bromide) แม้ว่าจะเป็นการทดแทนเพื่อจุดประสงค์อื่น อย่างการทำความสะอาดก็ตาม

จากนั้น เขาได้สั่งซื้อโซเดียมโบรไมด์จากอินเทอร์เน็ต มาใช้ปรุงอาหารแทนเกลือปรุงอาหารมาตลอดระยะเวลา 3 เดือน โดยไม่รู้เลยว่าเขากำลังค่อย ๆ วางยาพิษตัวเอง และทำให้เกิดภาวะโบรมิซึม (Bromism)

ภาวะโบรมิซึม คืออะไร ทำไมเป็นแล้วหลอน ?

อาการทั้งหมดที่เกิดขึ้นกับเขา ไม่ว่าจะเป็นอาการทางจิต อ่อนเพลีย นอนไม่หลับ เดินเซ หรือเป็นสิวเห่อเต็มหน้า ตรงกับอาการของภาวะโบรมิซึม Bromism หรือภาวะพิษจากโบรไมด์

โดยผลตรวจเลือดขั้นสุดท้ายยืนยันชัดว่า ระดับโบรไมด์ในเลือดของเขาทะลุไปถึง 1,700 mg/L ซึ่งสูงกว่าค่าปกติที่อยู่ราว 0.9 – 7.3 mg/L

จุดพีกของเรื่องก็คือ ค่าคลอไรด์ในเลือดที่สูงมากในตอนแรก จริง ๆ แล้วเป็นเพราะเครื่องตรวจในห้องแล็บให้ผลลัพธ์ที่ผิด เพราะโบรไมด์มีคุณสมบัติคล้ายกับคลอไรด์ จึงทำให้เครื่องตรวจวัดค่าผิดพลาด

แต่ดีที่ภาวะนี้รักษาให้หายได้ แค่หยุดกินโบรไมด์แล้วให้น้ำเกลือเพื่อช่วยล้างพิษออกจากร่างกาย หลังรักษาตัวอยู่ 3 สัปดาห์ อาการทางจิตของเขาก็หายจนกลับบ้านได้ตามปกติ

ถอดบทเรียน : เมื่อ AI มีหน้าที่ให้ข้อมูล แต่ไม่ได้ให้สติ

เคสนี้ไม่ใช่แค่เรื่องแปลกทางการแพทย์ แต่เป็นการแจ้งเตือนสำหรับใครที่ใช้ AI ในการปรึกษาเกี่ยวกับการดูแลสุขภาพและรักษาโรคด้วยตัวเองด้วย จากเรื่องราวของชายคนนี้ทำให้เราได้เห็นบทเรียนหลายอย่างที่สะท้อนถึงโลกในยุค AI ที่แม้ว่ามันจะทรงพลัง แต่ผู้ใช้งานก็มีส่วนรับผิดชอบในการรู้เท่าทันสิ่งประดิษฐ์ที่ดูเหมือนจะฉลาดนี้ด้วย เรามาถอดบทเรียนเรื่องนี้ไปด้วยกัน

AI ให้ข้อมูลถูก แต่ขาดบริบท

แม้ว่า AI จะตอบถูกตามหลักเคมี ว่าโซเดียมโบรไมด์ใช้แทนโซเดียมคลอไรด์ได้ แต่สิ่งที่มันไม่ได้บอก (เพราะมันไม่รู้) คือบริบทสำคัญว่า “โซเดียมโบรไมด์ นี่ห้ามกินนะ มันเป็นพิษ !” ซึ่งในส่วนนี้อาจเป็นความรับผิดชอบของผู้พัฒนาที่ควรให้ความสำคัญในมิติที่มากกว่าการให้ข้อมูลสำหรับเนื้อหาบางอย่างที่มีความละเอียดอ่อน และเกี่ยวข้องต่อสุขภาพ หรือแม้แต่ความเป็นความตาย

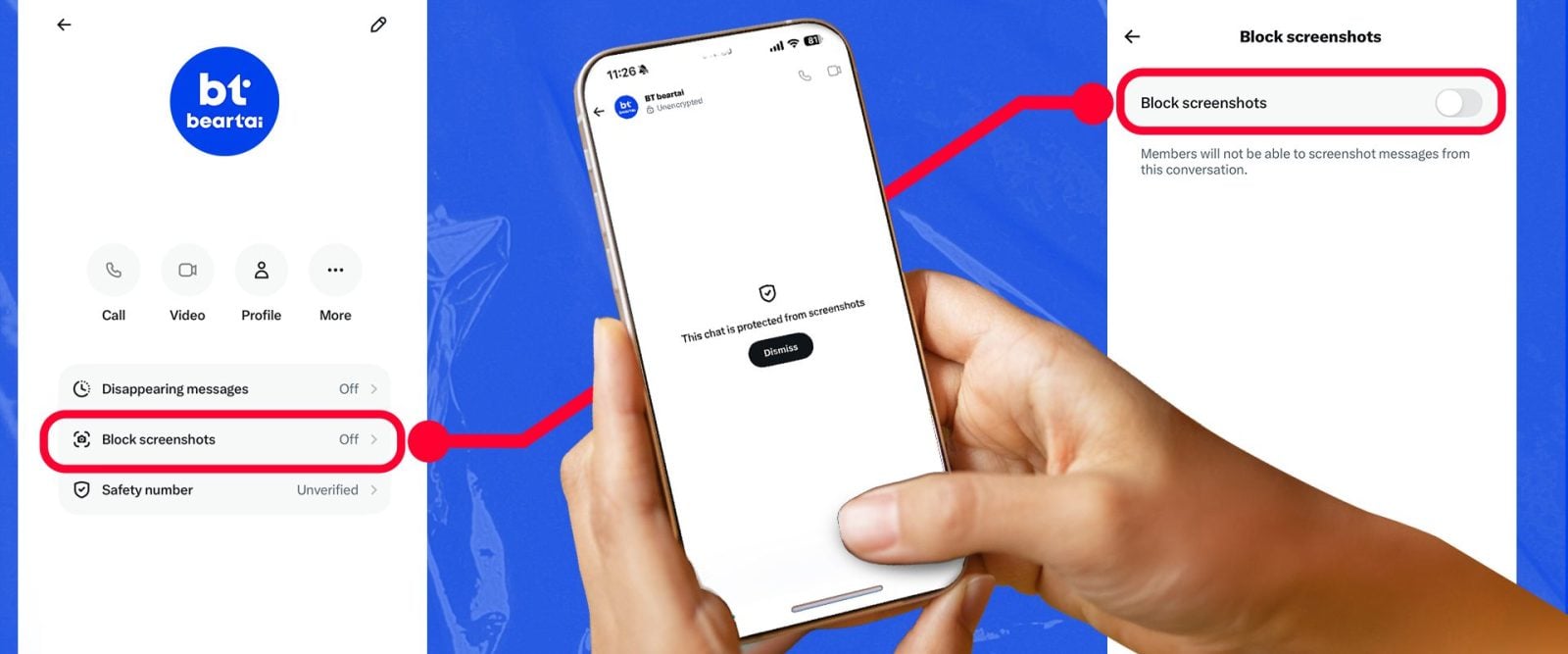

AI ถามกลับไม่เป็น

AI บางเจ้า และการใช้งานบางประเภทถูกออกแบบมาให้ถามกลับ แต่อาจจะไม่ใช่กับการพรอมต์เพื่อถามข้อมูลทั่วไปอย่างในเคสนี้ และ AI ไม่ใช่หมอ มันถามกลับไม่ได้ว่า “คุณจะเอาไปทำอะไร ?” เพราะไม่ได้เข้าใจบริบทที่ผู้ใช้ถามอย่างแท้จริง ในมุมนี้ ส่วนหนึ่งก็อาจเป็นหน้าที่ของผู้ใช้ที่จะต้องศึกษาการใช้ AI อย่างรอบคอบ เพื่อลดความเสี่ยงของการตัดสินใจผิดพลาดด้วยเหมือนกัน

คำตอบจาก AI + คนที่ไม่รู้ = เฟกนิวส์

แม้ AI จะช่วยให้คนเข้าถึงความรู้ได้ง่าย แต่ถ้าคนนำไปใช้แบบผิด ๆ ถูก ๆ และขาดความเข้าใจ ก็อาจกลายเป็นเรื่องใหญ่ได้เหมือนกัน ลองจินตนาการว่า หากในช่วงก่อนที่ชายคนนี้จะเกิดอาการหลอนและไปหาหมอ เขาได้เผยแพร่ข้อมูลการใช้โบรไมด์แทนคลอไรด์บน TikTok ให้กับผู้สูงอายุจะเกิดอะไรขึ้น

สุดท้ายแล้ว ต่อให้ AI จะเก่งแค่ไหน มันก็ยังเป็นแค่เครื่องมือที่มีช่องโหว่ ไม่ใช่แค่ในเรื่องสุขภาพแบบในเคสนี้เท่านั้น ลองจินตนาการว่าคุณอยากซ่อมเครื่องใช้ไฟฟ้าด้วยตัวเอง จากขั้นตอนการซ่อมที่ได้มาจาก AI โดยที่คุณไม่เข้าใจมันด้วยซ้ำ แค่ทำตามที่มันบอก ผลลัพธ์จากการซ่อมเครื่องใช้ไฟฟ้าอาจลงเอยด้วยการซื้อบ้านใหม่จากเหตุเพลิงไหม้ หรือไม่ก็ถูกหามเข้าโรงพยาบาล เพราะถูกไฟดูด

สำหรับใครที่มีปัญหาด้านสุขภาพ โดยเฉพาะคนที่มีโรคประจำตัว BT beartai ขอแนะนำให้คุณไปพบแพทย์เพื่อตรวจและวางแผนการรักษาอย่างเหมาะสมนะครับ